OpenAI presentó una nueva herramienta llamada Trusted Contact para ChatGPT que busca ayudar en situaciones de riesgo de auto-daño. Los usuarios ahora podrán elegir a una persona de confianza para que la compañía se comunique con ella si el sistema detecta un peligro serio.

Cada vez más personas usan el chatbot como una especie de terapeuta digital para conversar sobre su salud mental. Según datos de la propia empresa, más de un millón de sus 800 millones de usuarios semanales expresan pensamientos suicidas en las charlas.

Esta función llega después de varios cuestionamientos públicos. El año pasado, OpenAI enfrentó una demanda por muerte injusta, donde se acusaba al chatbot de haber contribuido al suicidio de un adolescente. Además, una investigación de la BBC reveló casos donde ChatGPT dio consejos inadecuados sobre cómo quitarse la vida.

Cómo funciona Trusted Contact

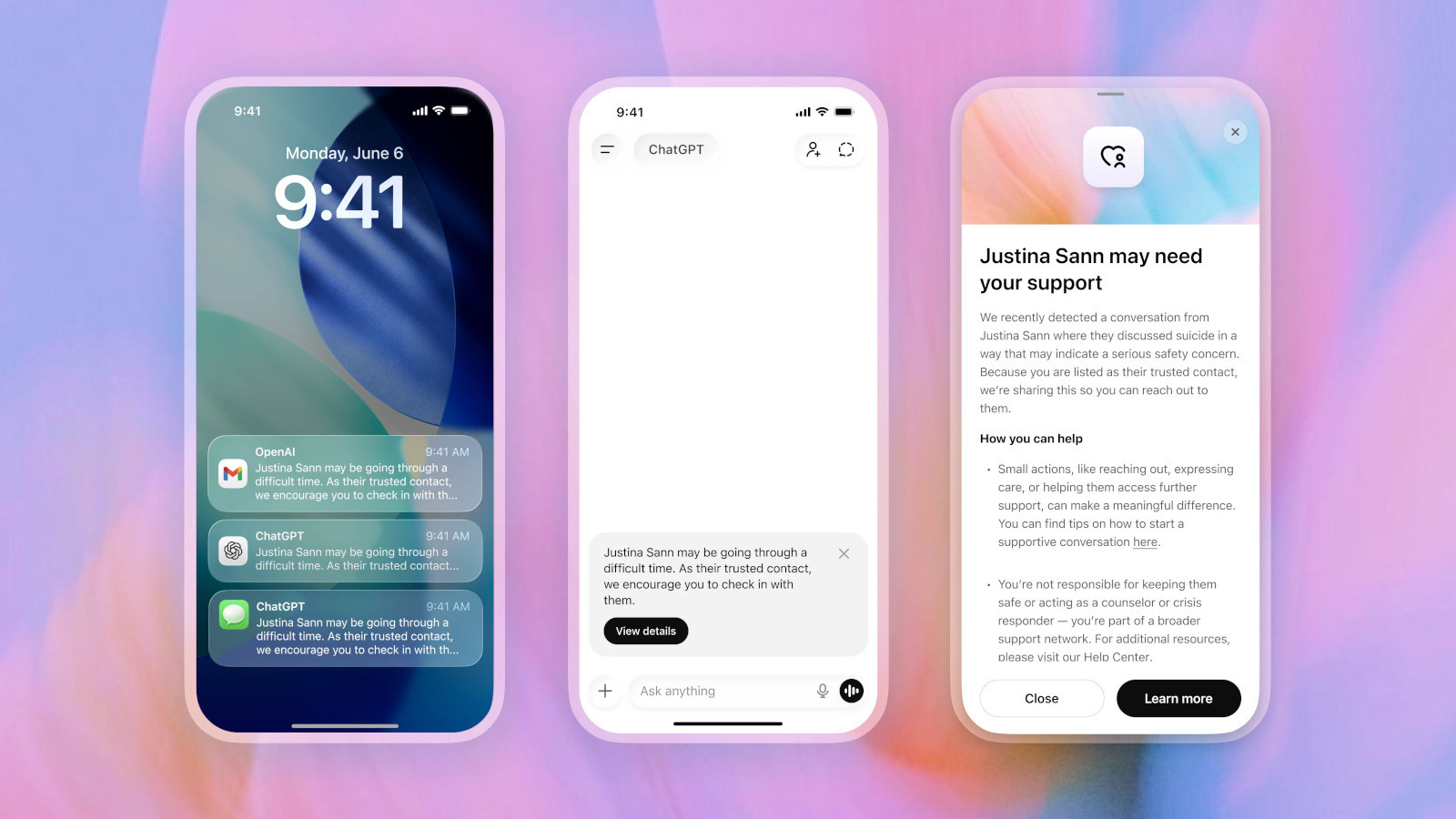

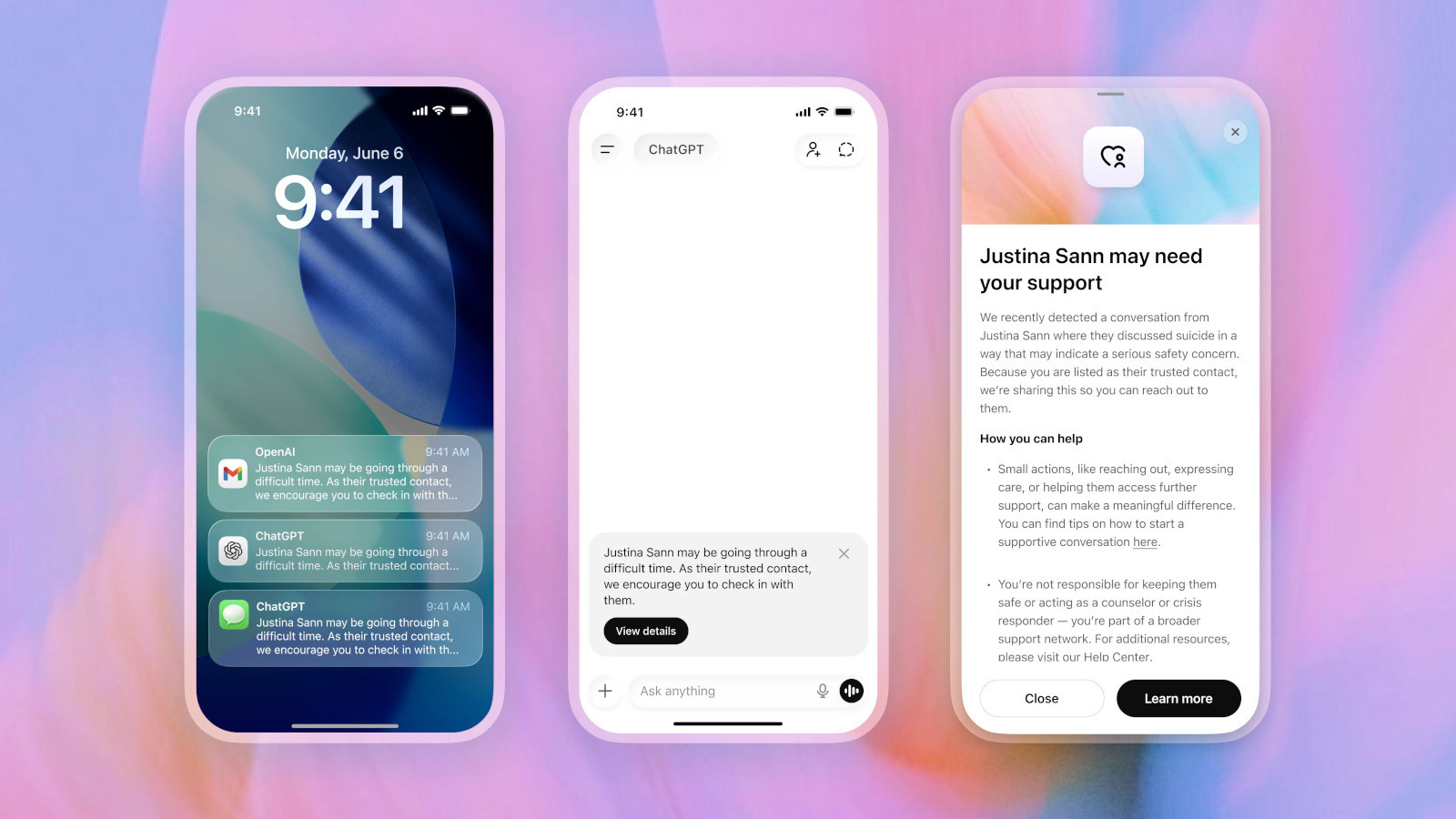

La opción se basa en los controles parentales existentes y está disponible para mayores de 18 años. En la configuración de ChatGPT, el usuario puede nominar a un adulto como contacto de confianza. Esa persona debe aceptar la invitación en un plazo de una semana; si no lo hace, se puede elegir a otro.

Antes de cualquier alerta, el sistema advierte al usuario que podría notificar a su contacto si se detecta un riesgo importante. Incluso le sugiere al usuario que se comunique directamente con su amigo y le ofrece posibles frases para iniciar la conversación.

El proceso no es automático. Un pequeño equipo de personas especialmente capacitadas revisa cada caso. Solo si confirman un serio riesgo de autolesión, ChatGPT envía un mensaje al contacto a través de email, SMS o notificación en la app.

El texto que recibe el contacto dice algo como: "Puede estar pasando por un momento difícil. Como su contacto de confianza, te alentamos a que te comuniques con él". No se comparten transcripciones de las conversaciones para proteger la privacidad del usuario.

Revisión humana y limitaciones

Desde OpenAI destacaron que "ningún sistema es perfecto" y que cada notificación pasa por revisión humana antes de enviarse. La empresa se esfuerza por revisar estos avisos de seguridad en menos de una hora.

Esta iniciativa busca equilibrar la seguridad con la privacidad, ofreciendo una red de apoyo real en momentos críticos sin exponer detalles sensibles de las charlas. Representa un paso más en la forma en que OpenAI maneja conversaciones delicadas sobre salud mental.

Los expertos coinciden en que, si bien los chatbots pueden ser útiles como primer apoyo, no reemplazan la atención profesional. Ante pensamientos suicidas, siempre se recomienda buscar ayuda inmediata en líneas especializadas.

Con Trusted Contact, OpenAI intenta sumar una capa extra de protección para quienes confían en la IA en sus momentos más vulnerables, fomentando que las personas cercanas intervengan a tiempo.

La función ya está disponible para configurar y refleja el compromiso de la compañía por mejorar sus respuestas en situaciones de distress, tras las mejoras anunciadas luego de las críticas recibidas.